OpenAI تطلق gpt-oss-safeguard: نماذج أمان مفتوحة تفهم “سياسة منصّتك”

3 د

أطلقت OpenAI النسخة التجريبية gpt‑oss‑safeguard لأمان الذكاء الاصطناعي المفتوح المصدر.

النماذج متوفرة بسعتين مختلفتين تحت رخصة Apache 2,0 للتعديل والاستخدام الحر.

النموذج يستخدم "الدفاع في العمق" لتطبيق سياسات السلامة بمرونة دون إعادة تدريب.

الشركة شكلت شراكات بحثية لتأسيس مجتمع النماذج المفتوحة لتطوير السلامة الرقمية.

المنهجية الجديدة تدعم سياسات سلامة مرنة وقابلة للتخصيص وفق احتياجات المستخدمين.

في خطوة تفتح الباب أمام مطورين وباحثين من مختلف أنحاء العالم، أعلنت شركة OpenAI عن إصدار تجريبي جديد يحمل اسم gpt-oss-safeguard، وهو نموذج مفتوح المصدر صُمم خصيصًا لمهام التصنيف والسلامة الرقمية. يأتي المشروع في نسختين مختلفتين من حيث السعة: 120 مليار و20 مليار مع توفيرهما برخصة Apache 2.0، ما يعني أن أي جهة يمكنها استخدامها وتعديلها بحرية تامة.

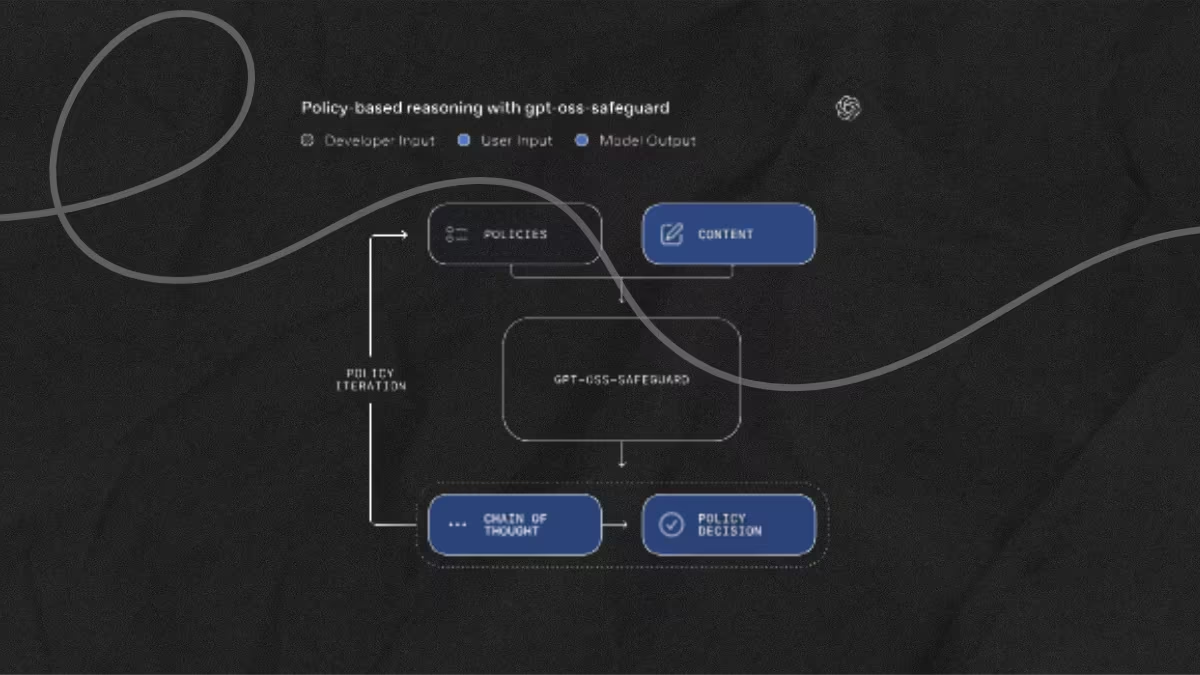

هذا الإعلان يضيف طبقة جديدة إلى فلسفة الذكاء الاصطناعي المفتوح التي تتبناها الشركة، إذ تجمع النماذج الجديدة بين التفكير المنطقي (Reasoning) ومرونة السياسات المخصصة، بحيث يستطيع المطور تحديد سياسة السلامة التي يريد تطبيقها أثناء تشغيل النموذج نفسه، وليس أثناء تدريبه فقط. بذلك، تنتقل السيطرة من صانع النموذج إلى مستخدمه، فيتحكم الأخير في حدود القرار ومعايير الأمان التي تناسب مجاله.

وهذا يربط بين فلسفة الذكاء المسؤول لدى OpenAI ورغبتها في تمكين المؤسسات من بناء أدوات أكثر توافقًا مع قيمها التشغيلية.

فلسفة جديدة: الدفاع بعمق وتخصيص السياسات

تستند gpt-oss-safeguard إلى مفهوم تسميه الشركة الدفاع في العمق، أي بناء طبقات متعددة من الحماية. في الماضي كانت أنظمة السلامة التقليدية تعتمد على تدريب مصنّفات ضخمة على آلاف الأمثلة لتتعرف على المحتوى "الضار"، لكن أي تعديل في السياسة كان يتطلب إعادة تدريب معقدة ومكلفة.

أما اليوم، فيمكن للنموذج الجديد تفسير السياسة نفسها في زمن التنفيذ وتحليل النصوص وفقًا لها مباشرة.

ويتجلى هذا التحول في قدرة المنظومة على فهم سياسات مكتوبة بواسطة المطور نفسه، مما يسمح بتطبيقها على منتديات ألعاب، أو تقييم مراجعات المنتجات، أو مراقبة المحادثات العامة. هذا المفهوم الذي تسميه OpenAI محاذاة تفكيرية (Deliberative Alignment) يمثل نقلة نوعية في كيفية تعامل الذكاء الاصطناعي مع الأمن الرقمي.

وهنا تتضح العلاقة بين الجهود الداخلية للشركة وتوجهها نحو فتح المصدر، حيث تتيح للمجتمع اختبار وتطوير هذه المقاربة الجديدة جماعيًا.

الأداء والاختبارات: نتائج تفوق التوقعات

خضعت النماذج الجديدة لسلسلة من الاختبارات الداخلية والخارجية، قارنت أداءها مع أنظمة سابقة مثل gpt-5-thinking والمصنفات التقليدية ضمن واجهة Moderation API.

في اختبارات الدقة متعددة السياسات، أظهرت gpt-oss-safeguard أداءً يفوق النماذج الأقدم، على الرغم من صغر حجمها النسبي، ما يعد مؤشرًا مهمًا على كفاءة آلية التفكير التحليلي مقارنة بالتصنيف الجامد.

كما تضمنت التقييمات مجموعات بيانات مفتوحة مثل ToxicChat وModeration Dataset 2022، وأظهرت النتائج أن النماذج الجديدة قادرة على تحقيق توازن جيد بين السرعة والدقة، رغم أن تصنيفات مدرَّبة على عشرات الآلاف من الأمثلة ما تزال تتفوق أحيانًا من حيث الأداء الدقيق في المجالات عالية المخاطر.

ويكشف هذا التوازن عن اتجاه متنامٍ في الصناعة نحو الجمع بين التعلم العميق والاستدلال الرمزي لتحسين استيعاب السياقات المعقدة.

شراكات بحثية ومجتمعات مفتوحة

إلى جانب الإطلاق، دشّنت OpenAI شراكة مع منظمة ROOST وشركات أخرى متخصصة في الأمان الرقمي لتأسيس مجتمع النماذج المفتوحة (RMC)، وهو مساحة تفاعلية تتيح للباحثين تبادل الملاحظات وتطوير أدوات السلامة المفتوحة.

وبهذه الخطوة، تفتح الشركة الباب أمام تعاون واسع يستفيد منه مطورو المنصات ومنظمات المجتمع المدني الراغبة في ضبط بيئاتها الرقمية وفق معاييرها الخاصة.

وهذا يعزز رؤية OpenAI بأن سلامة الذكاء الاصطناعي مسؤولية جماعية، تتطلب من الخبراء والحكومات والشركات التعاون لتحديد ملامح الاستخدام الآمن في المستقبل.

نحو جيل جديد من أدوات الحماية الرقمية

تمثل gpt-oss-safeguard أكثر من مجرد نموذج تصنيف؛ إنها منهجية جديدة في التفكير بالذكاء الاصطناعي الآمن، قائمة على المرونة والشفافية. فبدل الاقتصار على سياسات ثابتة، يمكن الآن لأي مطور تعديلها لحظيًا حسب احتياجاته.

ومع أن هذا النهج يتطلب موارد حوسبة أكبر، إلا أنه يفتح المجال لابتكار أدوات حماية مخصصة وقابلة للتطور المستمر.

باختصار، تستعد OpenAI من خلال هذا الإطلاق لوضع أسس بيئة رقمية أكثر أمانًا وانفتاحًا، حيث يصبح الذكاء الاصطناعي شريكًا مسؤولًا في صون الفضاءات الإلكترونية، لا مجرد أداة غير خاضعة للضبط.

عبَّر عن رأيك

إحرص أن يكون تعليقك موضوعيّاً ومفيداً، حافظ على سُمعتكَ الرقميَّةواحترم الكاتب والأعضاء والقُرّاء.

LEAP26

LEAP26 ASUS

ASUS RØDE

RØDE REDMAGIC

REDMAGIC TV

TV Partner With Us

Partner With Us