غضب يجتاح موظفي ميتا بسبب إلزامهم بالمشاركة في تدريب أنظمة الذكاء الاصطناعي على بياناتهم

تثير Meta الجدل بسبب تتبع تفاعلات الموظفين لتحسين الذكاء الاصطناعي.

يهدف البرنامج لجمع بيانات حول استخدام الموظفين لتطبيقات العمل الشائعة.

التوجه يركز على تدريب النماذج لفهم كيفية إنجاز المهام اليومية على الكمبيوتر.

تتعامل Meta مع البرنامج كامتداد لسياسات مراقبة قائمة وليست تحوّلاً جذريًا.

النجاح قد يدفع شركات أخرى لتبني نماذج مشابهة مستقبلًا.

تخيل أن كل نقرة بالفأرة، وكل اختصار على لوحة المفاتيح، قد تُصبح لاحقاً مادة تدريب لنموذج ذكاء اصطناعي. هذا تحديداً ما أثار جدلاً داخل أروقة Meta بعد إعلانها عن تثبيت برمجية جديدة على أجهزة موظفيها في الولايات المتحدة لتتبع تفاعلاتهم اليومية مع الحاسوب، بهدف تحسين أداء أنظمة الذكاء الاصطناعي لديها.

ما الذي يحدث داخل Meta؟

بحسب تقرير نشره موقع Business Insider، أطلقت Meta برنامجاً داخلياً يجمع بيانات حول استخدام الموظفين لتطبيقات العمل الشائعة مثل Gmail وGChat وأداتها الداخلية Metamate. الهدف المعلن هو تدريب النماذج على فهم كيفية إنجاز البشر للمهام اليومية على الكمبيوتر، من اختيار القوائم المنسدلة إلى استخدام اختصارات لوحة المفاتيح.

إدارة الشركة أوضحت في مذكرتها الداخلية أن هذه البيانات لن تُستخدم لأغراض أخرى، وأن هناك ضوابط لحماية المحتوى الحساس. لكن الرسالة الأوضح جاءت من تعليق المدير التقني أندرو بوسوورث الذي أكد أنه لا يوجد خيار للانسحاب من البرنامج على أجهزة العمل.

لكي تفهم الوكلاء البرمجيون كيف يُنجز الناس مهامهم فعلياً، نحتاج إلى تدريب نماذجنا على أمثلة حقيقية

لماذا يثير ذلك القلق؟

الاعتراضات داخل الشركة لم تكن هامشية. التفاعل الأكثر شيوعاً على المذكرة كان رمز الوجه الغاضب، وأبرز تعليق تساءل عن كيفية الانسحاب من البرنامج. هذا التباين يعكس توتراً معروفاً في بيئة العمل التقنية: الموازنة بين تطوير تقنيات أكثر ذكاءً، والحفاظ على شعور الموظفين بالخصوصية والسيطرة.

صحيح أن أجهزة العمل في الشركات الكبرى تخضع عادةً لأنظمة مراقبة وإدارة، لكن الانتقال من مراقبة أمنية تقليدية إلى جمع بيانات سلوكية دقيقة لتدريب الذكاء الاصطناعي يضيف طبقة جديدة من الحساسية. الفرق هنا ليس في المبدأ فقط، بل في الغاية ونطاق التحليل الخوارزمي.

الذكاء الاصطناعي يتعلّم من الواقع

من منظور تقني، هذه الخطوة منطقية ضمن سباق تطوير ما يُعرف بوكلاء الذكاء الاصطناعي القادرين على تنفيذ مهام على الكمبيوتر نيابةً عن المستخدم. لكي ينجح هذا النوع من الأنظمة، لا يكفي تدريبه على نصوص أو أوامر، بل يحتاج إلى بيانات تفاعلية تعكس السلوك البشري الحقيقي داخل الواجهات والتطبيقات.

- تحسين فهم التسلسل الفعلي للمهام داخل بيئات العمل.

- محاكاة استخدام الاختصارات والتنقل بين النوافذ.

- تقليل الفجوة بين الأوامر النظرية والتنفيذ العملي.

Meta، التي أعادت هيكلة فرقها ضمن وحدات تركز على الذكاء الاصطناعي وأطلقت مبادرات تدريب داخلية، تبدو وكأنها تنقل هذا التوجه من المختبرات إلى تفاصيل العمل اليومية.

مراقبة تقليدية أم تحوّل نوعي؟

بحسب المصادر، تخضع أعمال الموظفين على أجهزة الشركة للمراقبة منذ سنوات، وبالتالي تصف Meta البرنامج الجديد بأنه امتداد لسياسات قائمة، لا تحوّلاً جذرياً. ومع ذلك، فإن استخدام البيانات لتدريب نماذج تعلم آلي يغيّر طبيعة العلاقة بين الموظف والنظام الرقمي.

البيانات هنا لا تُراجع فقط لأغراض أمنية أو إدارية، بل تُغذّي شبكة عصبية تتعلم أنماط السلوك، وتستخلص منها نماذج قابلة للتعميم. هذا التحول من الرقابة إلى التعلم الآلي هو ما يجعل المسألة أعمق من تحديث تقني روتيني.

إلى أين يقود هذا المسار؟

ما يحدث داخل Meta قد لا يبقى شأناً داخلياً. إذا نجحت التجربة في تحسين أداء وكلاء الذكاء الاصطناعي، فقد نرى شركات أخرى تتبنى نماذج مشابهة. وحينها سيصبح السؤال أقل ارتباطاً بشركة بعينها، وأكثر تعلقاً بمعايير الشفافية، وسياسات الاستخدام، وحدود البيانات المقبولة في بيئات العمل.

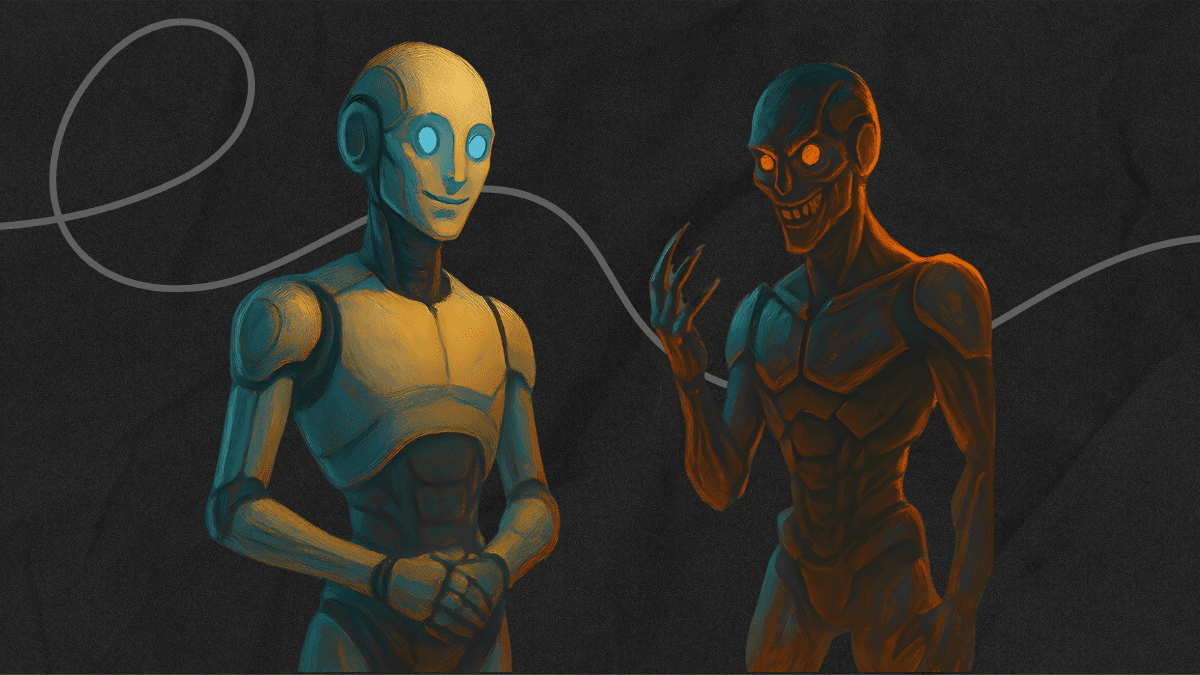

بين الطموح لبناء أنظمة تفهم البشر بدقة، والحاجة للحفاظ على ثقة الموظفين، تتشكّل معادلة حساسة. التقنية تتقدم، لكن قبولها الاجتماعي يبقى العامل الذي يحدد إن كانت ستُنظر إليها كأداة تمكين… أم كخطوة إضافية نحو مراقبة أكثر عمقاً.

عبَّر عن رأيك

إحرص أن يكون تعليقك موضوعيّاً ومفيداً، حافظ على سُمعتكَ الرقميَّةواحترم الكاتب والأعضاء والقُرّاء.

LEAP26

LEAP26 ASUS

ASUS RØDE

RØDE REDMAGIC

REDMAGIC TV

TV Partner With Us

Partner With Us