ChatGPT يخدع العلماء بكتابة أوراق بحثية دقيقة كأنه بشر!

2 د

تمكن نموذج الذكاء الصنعي ChatGPT المثير للجدل من خداع أشهر العلماء وجعلهم يعتقدون أنهم يقرؤون نصًا كتبه إنسان.

ChatGPT التابع لشركة Open Ai هو نموذج لروبوت فائق الذكاء يمكنه كتابة المقالات والنصوص والإجابة على الأسئلة المختلفة وتقديم "وجهة نظره" كخبير في مختلف المواضيع بطريقة أقرب للبشر لدرجة أنه تمكن من خداع عدد كبير من الخبراء وجعلهم يعتقدون أنهم يتكلمون مع إنسان بشري.

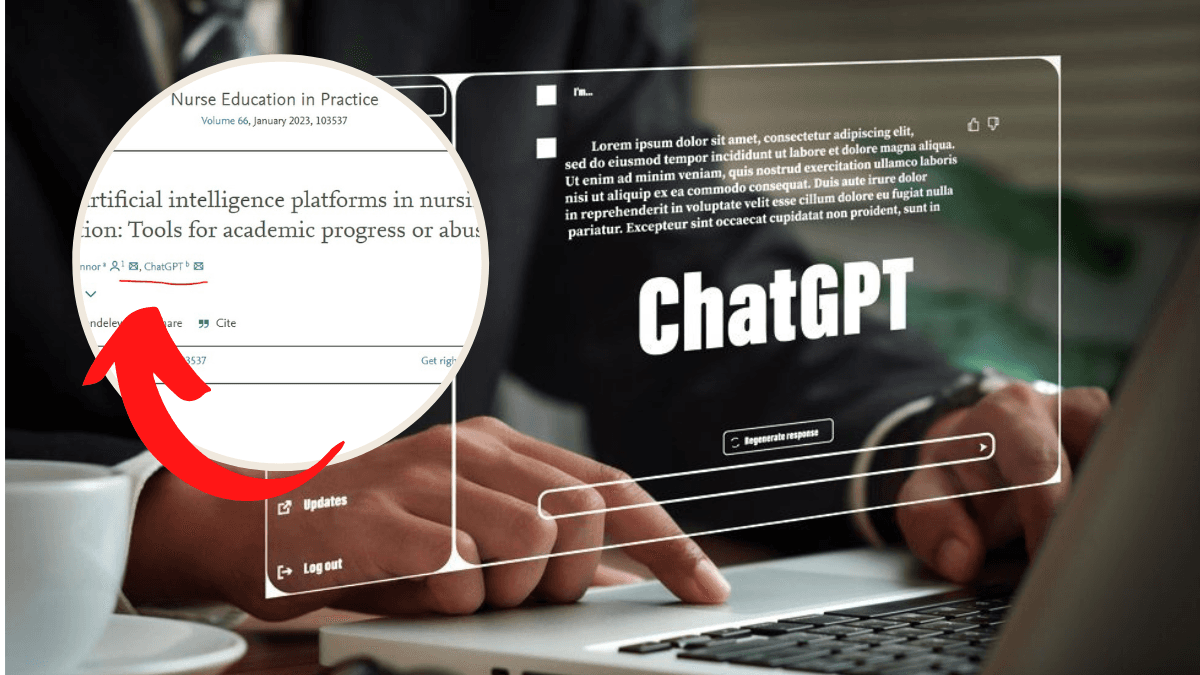

قامت مجموعة من الباحثين بعرض ملخصات أوراق بحثية مزيفة لاختبار مجموعة من العلماء المخضرمين ما إذا كان بإمكانهم اكتشاف الفرق، حيث تم تكليف ChatGPT بكتابة 50 ملخصًا للبحوث الطبية بعد أن تم تدريبه على مجموعة من الأمثلة الواردة في المجلة الطبية البريطانية (BMJ) وطب الطبيعة.

بعد عرض هذه العينات على العلماء طُلب منهم تحديد الملفات المزيفة، لكنهم اعتقدوا أن 32% من الملخصات الناتجة عن الذكاء الاصطناعي كانت حقيقية، ويعتبر هذا الرقم كبيرًا بالنسبة لمجموعة من الباحثين الطبيين الخبراء في هذا المجال، مما دفع الباحثة "ساندرا واتشتر" المختصة بالتكنولوجيا في جامعة هارفرد بالتصريح قائلة "أنا قلقة للغاية، إذا كنا الآن في موقف لا يستطيع فيه الخبراء تحديد ما هو صحيح أم لا، فإننا بذلك نفقد الوسيط الذي نحتاج إليه لإرشادنا في المواضيع المعقدة ".

بالرغم من أن هذا الاختراع مهم ومفيد لبعض الحالات الإنسانية إلا أنه يثير القلق لدى الخبراء كما أن الحدود الأخلاقية لهذه الأداة لم يتم تحديدها حتى الآن، بالإضافة لقدرته على زعزعة المعايير العلمية وخاصة في رسائل البحث والمشاريع الجامعية، لذلك من المهم إيجاد أجهزة نقيضة يمكنها الكشف عن عمليات التلاعب من أجل المحافظة على المعايير العلمية الصارمة.

ظهور هذا الذكاء الصنعي المتطور يعيدنا إلى أفلام الخيال العلمي والكتب التي كانت تحذر من سيطرة الآلة على البشر، وأظن أن تمكنه من خداع أكبر العلماء من أول محاولة له هو أمر خطير فعلًا ومخيف نوعًا ما، ومن المهم تعيين حدود الاستخدام الأخلاقي والمقبول لهذا النموذج.

أحلى ماعندنا ، واصل لعندك! سجل بنشرة أراجيك البريدية

بالنقر على زر “التسجيل”، فإنك توافق شروط الخدمة وسياسية الخصوصية وتلقي رسائل بريدية من أراجيك

عبَّر عن رأيك

إحرص أن يكون تعليقك موضوعيّاً ومفيداً، حافظ على سُمعتكَ الرقميَّةواحترم الكاتب والأعضاء والقُرّاء.