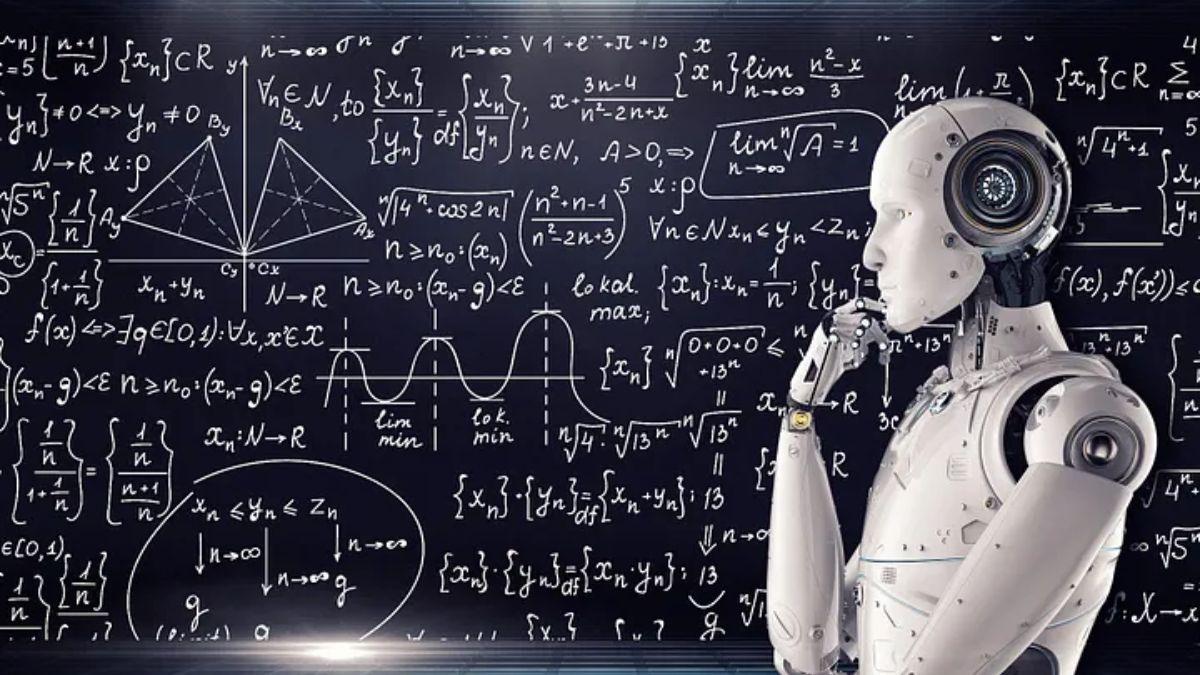

حقائق مخيفة حول الذكاء الاصطناعي: تهديدات الوظائف والتحيز والخصوصية تثير الجدل العالمي

2 د

يثير الذكاء الاصطناعي مخاوف بشأن تهديد بعض الوظائف وتعزيز عدم المساواة الاقتصادية.

قد يتسبب الذكاء الاصطناعي في تعزيز التحيزات الموجودة في المجتمع والتأثير على القرارات بطرق غير عادلة.

انتهاك الخصوصية وسوء استخدامها في ظل التطورات في مجال التقنيات المعتمدة على الذكاء الاصطناعي.

على الرغم من أن الذكاء الاصطناعي (AI) قد أحدث تحولات هائلة في العديد من المجالات، لكن من الضروري الاعتراف بالتحديات والمخاطر المرتبطة بهذه التكنولوجيا القوية.إذ تشمل هذه التحديات تهديد الوظائف، والتحيز والتمييز، ومخاوف الخصوصية، ونقص الشفافية، ومخاطر الأمان، والاعتبارات الأخلاقية.

يثير انتشار التطبيق الواسع للذكاء الاصطناعي مخاوف بشأن تهديد الوظائف. حيث أصبحت أنظمة الذكاء الاصطناعي المتقدمة قادرة على أداء المهام التي كانت تنجزها التقنيات التقليدية والتي يقوم بها البشر، مما يثير قلقًا بشأن تهديد الوظائف والتفاوت الاقتصادي.

جانب آخر هام هو التحيز والتمييز. إذ تم تدريب خوارزميات الذكاء الاصطناعي على كميات هائلة من البيانات، والتي قد تحتوي أحيانًا على التحيزات الموجودة في المجتمع. إذا لم يتم التعامل مع هذه التحيزات بشكل مناسب، يمكن أن تعزز أنظمة الذكاء الاصطناعي هذه التحيزات وتكبدها نتائج غير عادلة في مجالات عديدة مثل التوظيف والتمويل والعدالة الجنائية.

تثير انتشار أنظمة المراقبة التي تعتمد على الذكاء الاصطناعي مخاوف بشأن الخصوصية الفردية والاستخدام المسيء المحتمل. إذ تستطيع تقنيات الذكاء الاصطناعي جمع وتحليل وتخزين كميات ضخمة من البيانات الشخصية، مما يثير تساؤلات حول الموافقة وحماية البيانات واحتمالات انتهاك الخصوصية من قِبَل الجهات الحكومية وغير الحكومية.

نقص الشفافية والمساءلة يمثل تحديًا آخر في عمليات صنع القرار التي يتخذها الذكاء الاصطناعي. إذ يمكن أن تكون نماذج الذكاء الاصطناعي المعقدة مثل الشبكات العصبية صعبة التفسير، مما يثير قلقًا بشأن التحيز والمساءلة واحتمال الأخطاء أو العواقب غير المقصودة.

تعرض أنظمة الذكاء الاصطناعي لمخاطر الأمان والاستغلال. يمكن للأطراف الضارة أن تحاول التلاعب أو إيهام خوارزميات الذكاء الاصطناعي، مما يؤدي إلى اختراقات أمنية وسرقة الهوية أو انتشار المعلومات الخاطئة.

تثير تقنيات الذكاء الاصطناعي أيضًا تساؤلات أخلاقية معقدة. على سبيل المثال، القرارات التي يتخذها أنظمة الذكاء الاصطناعي في مجالات مثل الرعاية الصحية والمركبات ذاتية القيادة والتطبيقات العسكرية والتي يمكن أن تكون لها آثار عميقة على حياة البشر. لذلك يعد ضمان تطوير الذكاء الاصطناعي ونشره بشكل أخلاقي وبمراعاة القيم الإنسانية هو تحدي حاسم.

من الضروري التأكيد على أن هذه الجوانب السلبية المحتملة للذكاء الاصطناعي ليست جزءًا متأصِّلًا في التكنولوجيا نفسها، بل هي نتيجة لكيفية تطوير ونشر الذكاء الاصطناعي وتنظيمه. هناك العديد من الباحثين وصناع السياسة والمنظمات يعملون بنشاط على معالجة هذه المخاوف من خلال إرشادات أخلاقية وأطر تنظيمية ومناقشات مستمرة حول تطوير الذكاء الاصطناعي المسؤول.

أحلى ماعندنا ، واصل لعندك! سجل بنشرة أراجيك البريدية

بالنقر على زر “التسجيل”، فإنك توافق شروط الخدمة وسياسية الخصوصية وتلقي رسائل بريدية من أراجيك

عبَّر عن رأيك

إحرص أن يكون تعليقك موضوعيّاً ومفيداً، حافظ على سُمعتكَ الرقميَّةواحترم الكاتب والأعضاء والقُرّاء.